¿Qué es el robots.txt? Guía para controlar el rastreo de tu sitio

Índice de contenidos

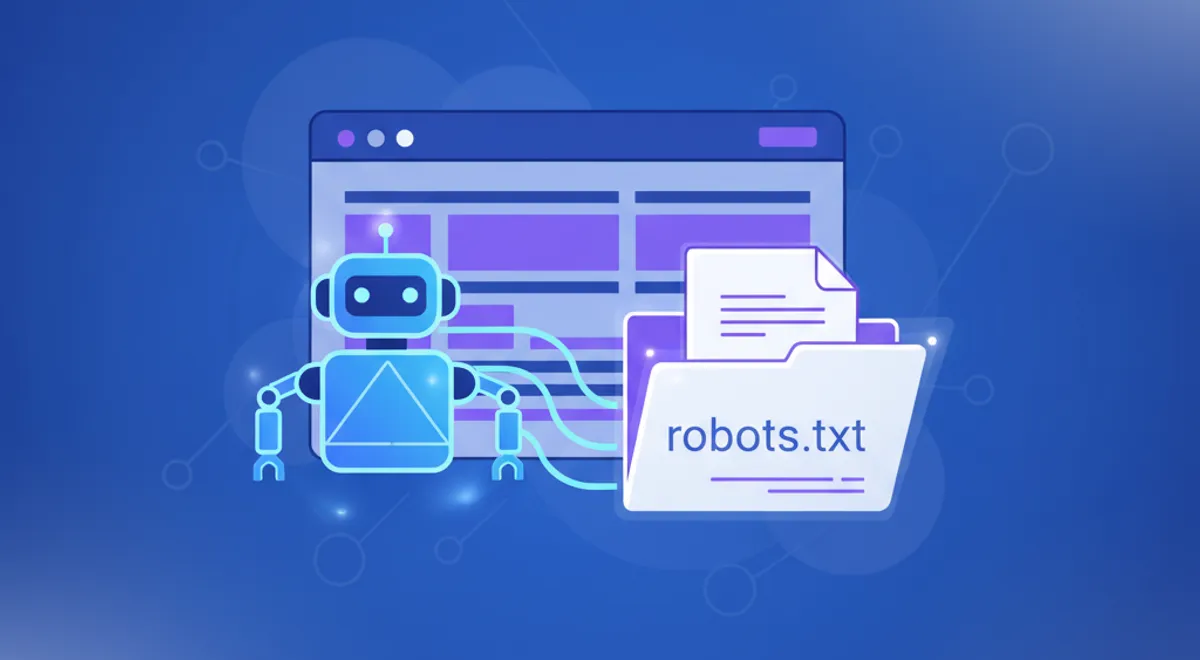

El archivo que los bots leen primero

Cada vez que un bot visita un sitio web, lo primero que hace es buscar un archivo en la raíz del dominio. Busca un archivo de texto plano llamado robots.txt, ubicado siempre en la misma dirección: tudominio.com/robots.txt. Lo que encuentre ahí determina qué páginas va a rastrear y cuáles va a ignorar.

El archivo robots.txt es un conjunto de instrucciones en texto plano que le indica a los rastreadores web (crawlers) qué secciones del sitio tienen permitido visitar y cuáles no. Google, Bing, Yandex y cualquier otro motor de búsqueda que respete el Robots Exclusion Protocol lee este archivo antes de recorrer las páginas.

Hay un detalle fundamental. El robots.txt funciona como un acuerdo de buena fe. Los bots que respetan el protocolo leen las instrucciones y las cumplen. Los bots maliciosos las ignoran.

Si el archivo no existe, los bots interpretan que todo el sitio está disponible para rastreo. La ausencia de restricciones equivale a una invitación abierta.

Sintaxis del robots.txt

La estructura del robots.txt se basa en tres directivas principales: User-agent, Disallow y Allow.

User-agent: *

Disallow: /admin/

Disallow: /privado/

Allow: /El asterisco en User-agent: * significa "todos los bots". La directiva Disallow: /admin/ bloquea el rastreo de cualquier URL que comience con /admin/.

Otra directiva útil es Sitemap, que indica la ubicación del mapa del sitio:

Sitemap: https://tudominio.com/sitemap.xmlErrores que generan problemas reales

- Bloquear recursos CSS o JavaScript que Google necesita para renderizar las páginas.

- Usar rutas incorrectas. Para limitar el bloqueo a una carpeta específica, la barra final importa.

- Colocar el archivo en el lugar equivocado. El robots.txt funciona exclusivamente cuando está en la raíz del dominio.

- Olvidar que cada subdominio necesita su propio archivo.

Bots de IA y el robots.txt

Los modelos de lenguaje (LLMs) como ChatGPT, Claude y Perplexity envían sus propios rastreadores a la web. El robots.txt es la herramienta que permite controlar su acceso.

Bots de IA más relevantes

| Bot | Empresa | Respeta robots.txt |

|---|---|---|

| GPTBot | OpenAI | Sí |

| ClaudeBot | Anthropic | Sí |

| PerplexityBot | Perplexity AI | Sí |

Para bloquear el acceso de todos los bots de IA a tu sitio completo:

User-agent: GPTBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: PerplexityBot

Disallow: /La decisión de bloquear o permitir estos bots es estratégica. Depende de si el valor está en proteger el contenido original o en ganar visibilidad en plataformas de IA.

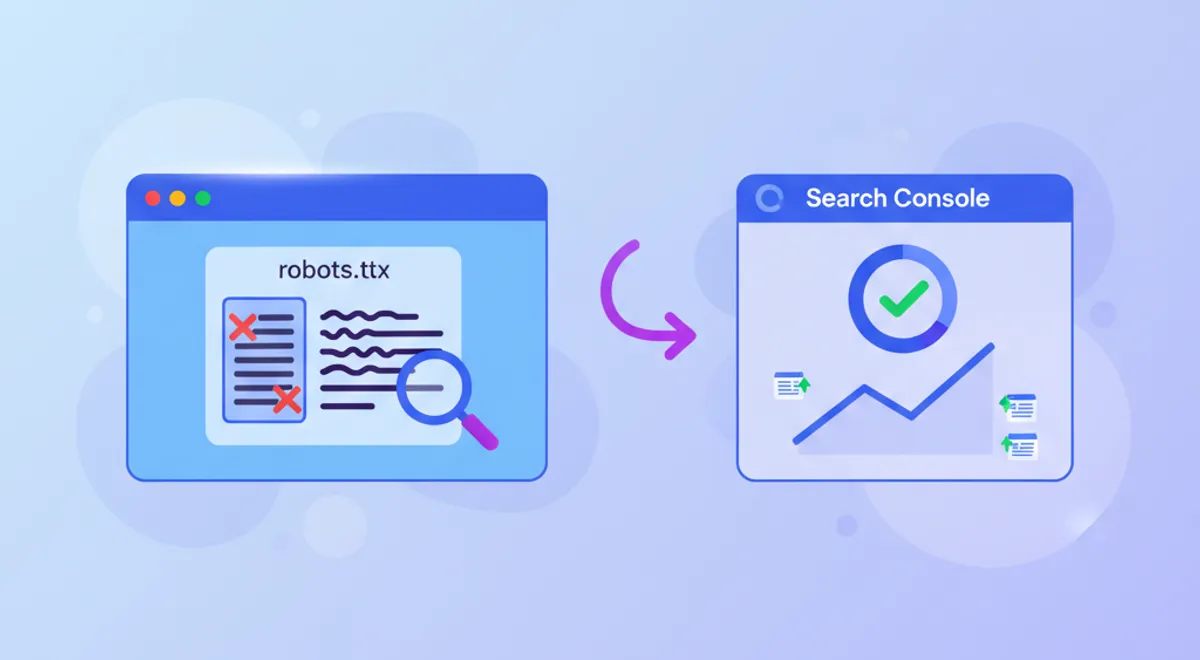

Verificar el robots.txt con Search Console

Google Search Console incluye una herramienta de inspección de URLs que permite verificar si una página está bloqueada por robots.txt.

El robots.txt no es un archivo que se configura una vez y se olvida. Lo que era una configuración correcta hace un año podría estar dejando la puerta abierta a rastreadores que ni existían cuando se escribió el archivo.

Preguntas frecuentes

¿El robots.txt puede evitar que una página aparezca en Google?

No directamente. Bloquear una URL con Disallow impide que Googlebot la rastree, pero si otros sitios enlazan a esa página, Google podría seguir mostrándola. Para eliminar una página del índice de forma efectiva, se necesita la etiqueta noindex.

¿Qué pasa si mi archivo robots.txt tiene un error de sintaxis?

Los bots intentan interpretar el archivo de la mejor manera posible, pero un error puede provocar que ignoren reglas completas o que bloqueen secciones que deberían estar accesibles.

¿Con qué frecuencia revisan los bots el archivo robots.txt?

Googlebot consulta el robots.txt periódicamente y almacena una copia en caché que puede durar hasta 24 horas.

¿Bloquear bots de IA afecta mi posicionamiento en buscadores tradicionales?

No. Las directivas para GPTBot, ClaudeBot o PerplexityBot son independientes de las que aplican a Googlebot o Bingbot. Bloquear rastreadores de IA no tiene ningún impacto en cómo los motores de búsqueda tradicionales indexan tu sitio.